Pengantar

Perkembangan kecerdasan buatan (Artificial Intelligence/AI) telah membawa perubahan besar dalam berbagai bidang, mulai dari industri teknologi, kesehatan, hingga keamanan siber. Model AI modern mampu menghasilkan teks, gambar, suara, dan bahkan kode program dengan kualitas yang semakin mendekati hasil buatan manusia. Namun, di balik kemajuan tersebut, muncul sebuah risiko baru yang mulai menjadi perhatian para peneliti, yaitu Model Collapse.

Model Collapse merupakan fenomena ketika sistem AI mengalami penurunan kualitas karena terlalu sering dilatih menggunakan data yang berasal dari AI lain. Jika tidak dikendalikan, kondisi ini dapat menyebabkan AI menghasilkan informasi yang tidak akurat, bias, bahkan kehilangan kemampuan memahami konteks dunia nyata.

Apa Itu Model Collapse?

Model Collapse adalah kondisi ketika model kecerdasan buatan secara bertahap kehilangan kualitas output akibat dilatih menggunakan data sintetis yang dihasilkan oleh model AI sebelumnya. Fenomena ini terjadi karena AI mulai belajar dari hasil buatan AI lain, bukan dari data asli yang berasal dari manusia atau dunia nyata.

Penelitian dari Nature menunjukkan bahwa pelatihan model AI menggunakan data sintetis secara berulang dapat menyebabkan hilangnya variasi informasi serta meningkatkan risiko kesalahan output (dikutip dari nature.com).

baca juga : Air-Gapped Systems: Benteng Keamanan Digital yang Diputus Total dari Internet

Bagaimana Model Collapse Bisa Terjadi?

Ketergantungan pada Data Sintetis

Model AI membutuhkan data dalam jumlah besar untuk belajar. Namun, ketika data asli semakin terbatas, pengembang terkadang menggunakan data yang dihasilkan AI sebagai data pelatihan tambahan. Jika proses ini terus berulang, kualitas data pelatihan akan menurun.

Penurunan Variasi Informasi

Data sintetis cenderung memiliki pola yang seragam. Hal ini membuat model AI kehilangan keberagaman informasi yang penting untuk memahami berbagai kondisi dunia nyata.

Efek Akumulasi Kesalahan

Ketika AI menghasilkan data yang sedikit keliru, kesalahan tersebut dapat diwariskan ke model berikutnya. Jika pelatihan dilakukan berulang kali, kesalahan kecil dapat berkembang menjadi bias besar.

Distorsi Fakta dan Informasi

Model AI yang mengalami Model Collapse berpotensi menghasilkan informasi yang terdengar meyakinkan tetapi tidak akurat.

Dampak Model Collapse dalam Dunia Teknologi

Menurunnya Akurasi Sistem AI

Model Collapse dapat menyebabkan AI menghasilkan jawaban yang kurang relevan, berulang, atau bahkan salah secara faktual. Hal ini berbahaya terutama pada sistem yang digunakan untuk pengambilan keputusan penting.

Risiko dalam Keamanan Siber

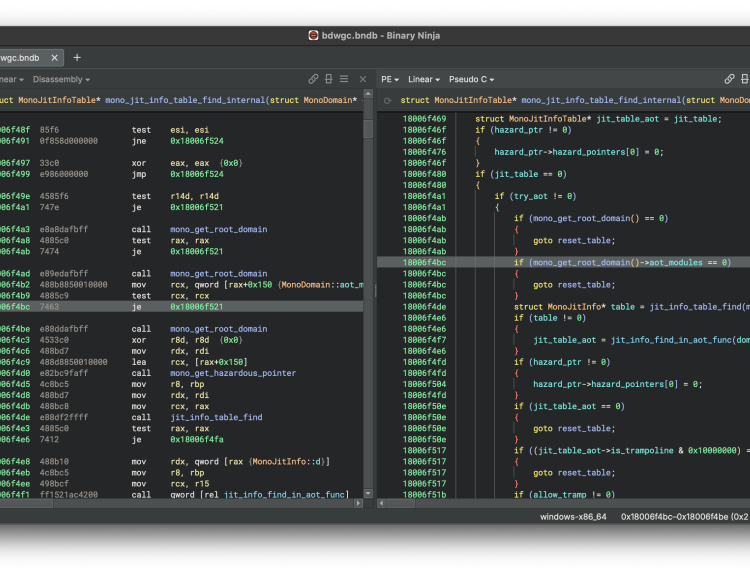

Dalam bidang keamanan siber, AI sering digunakan untuk mendeteksi ancaman digital. Jika model AI mengalami penurunan kualitas, sistem keamanan dapat gagal mendeteksi serangan baru.

Menurunnya Kepercayaan Pengguna

Pengguna cenderung mengandalkan AI untuk berbagai kebutuhan. Jika AI menghasilkan informasi yang salah secara konsisten, tingkat kepercayaan terhadap teknologi ini dapat menurun.

baca juga : Neural Networks: Mengintip Cara Kerja ‘Saraf Tiruan’ yang Membuat Komputer Bisa Berpikir Seperti Manusia

Faktor Penyebab Model Collapse

Keterbatasan Data Asli

Semakin banyak model AI digunakan, semakin sulit memperoleh data baru yang benar-benar berasal dari manusia.

Overfitting terhadap Data Sintetis

Model AI dapat menjadi terlalu fokus pada pola data buatan sehingga kehilangan kemampuan memahami kondisi nyata.

Kurangnya Validasi Data

Tanpa proses verifikasi data yang ketat, model AI berisiko mempelajari informasi yang tidak akurat.

Cara Mencegah Model Collapse

Menggunakan Data Berkualitas Tinggi

Pengembang AI perlu memastikan bahwa data pelatihan berasal dari sumber terpercaya dan memiliki variasi yang cukup.

Kombinasi Data Manusia dan AI

Menggabungkan data manusia dengan data sintetis dapat membantu menjaga keseimbangan kualitas pembelajaran model.

Validasi dan Kurasi Data

Proses evaluasi data secara berkala dapat membantu mendeteksi kesalahan sebelum digunakan dalam pelatihan model AI.

Pengembangan Model yang Lebih Adaptif

Peneliti terus mengembangkan metode pelatihan AI yang mampu mengenali dan mengurangi dampak data sintetis berlebihan.

baca juga : SQL Truncation: Celah Validasi Data yang Bisa Membuka Jalan Serangan Berbahaya

Kesimpulan

Model Collapse merupakan ancaman baru dalam pengembangan kecerdasan buatan yang muncul akibat ketergantungan pada data sintetis. Fenomena ini dapat menurunkan akurasi, meningkatkan bias, serta mengurangi keandalan sistem AI jika tidak ditangani dengan baik.

Untuk mencegah Model Collapse, pengembang perlu memastikan kualitas dan keberagaman data pelatihan, melakukan validasi secara rutin, serta mengembangkan metode pembelajaran yang lebih adaptif. Dengan pengelolaan yang tepat, AI dapat terus berkembang tanpa kehilangan kualitas dan keandalannya.

1 Comment

Time-Series Database: Solusi Mengelola Data Berbasis Waktu di Era Big Data - buletinsiber.com

3 months ago[…] baca juga : Model Collapse: Ancaman Tersembunyi Saat AI Belajar dari AI […]