1. Kebutuhan HPC dan Tantangan Komputasi

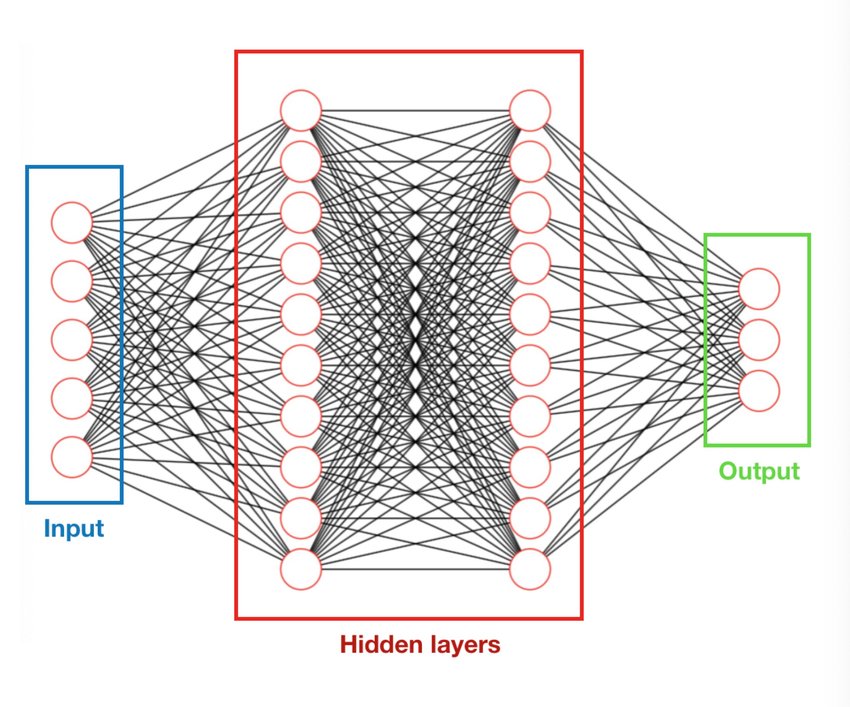

High-Performance Computing (HPC) merupakan lingkungan komputasi berskala besar yang dirancang untuk menjalankan pekerjaan komputasi intensif seperti simulasi fisika, analitik data berskala petabyte, bioinformatika, atau pelatihan model AI besar. HPC membutuhkan sumber daya yang sangat besar, termasuk banyak CPU core, GPU berkinerja tinggi, memori besar, dan interkoneksi jaringan yang sangat cepat.

Kebutuhan Utama Lingkungan HPC

-

Performa CPU/GPU Maksimal

HPC mengeksekusi aplikasi lintas node dengan kebutuhan komputasi tinggi, seperti CFD, climate modeling, genomik, training deep neural networks, hingga simulasi kuantum. -

Bandwidth dan Latency Jaringan Rendah

HPC tradisional menggunakan jaringan berkecepatan tinggi seperti Infiniband, OmniPath, atau NVLink untuk memastikan komunikasi antar-node sangat cepat. -

Konsistensi I/O yang tinggi

Banyak workload HPC memerlukan I/O paralel besar ke parallel filesystem seperti Lustre, GPFS, atau BeeGFS. -

Skalabilitas Horizontal

Cluster HPC harus mampu tumbuh sampai ribuan node untuk mendukung simulasi besar.

Tantangan Besar Dalam HPC

-

Overhead Virtualization

Pada awalnya virtualisasi dianggap tidak cocok untuk HPC karena menambah latensi dan mengurangi akses langsung ke hardware. -

Hypervisor Interference

Layer virtualisasi dapat menyebabkan jitter waktu eksekusi, yang sangat merugikan aplikasi paralel HPC. -

Dukungan Hardware Accelerator

Menjalankan GPU, TPU, atau FPGA di lingkungan VM membutuhkan teknologi tambahan seperti pass-through atau virtual GPU. -

I/O Bottleneck

Virtual machine layer dapat menghambat throughput storage dan komunikasi antar-node.

Meskipun demikian, kemajuan teknologi membuat virtualisasi semakin layak digunakan dalam konteks HPC modern, terutama untuk AI dan analitik data.

2. VM dan GPU Virtualization untuk AI/ML

Virtualisasi dalam konteks HPC lebih banyak dipakai dalam workload AI/ML, data analytics, dan containerized HPC. Teknologi yang paling relevan untuk riset modern melibatkan:

1. GPU Virtualization

Teknologi GPU virtualization memungkinkan satu GPU fisik digunakan secara bersama oleh beberapa VM melalui:

-

NVIDIA vGPU

-

AMD MxGPU

-

Intel GVT-g

Dengan vGPU, peneliti dapat menjalankan:

-

Pelatihan model AI berskala besar

-

Eksperimen ML paralel dengan resource sharing

-

Pengujian multi-user pada GPU cluster

2. GPU Passthrough

Untuk performa mendekati bare-metal, VM dapat diberikan akses langsung ke GPU fisik menggunakan:

-

IOMMU

-

VFIO passthrough

-

SR-IOV

Teknik ini memberikan akses nyaris 100% performa GPU tanpa overhead signifikan.

3. CPU Virtualization untuk HPC

Dengan kemajuan hypervisor seperti:

-

KVM

-

Xen

-

VMware ESXi

-

Microsoft Hyper-V

VM mampu menjalankan workload intensif seperti:

-

HPC molecular dynamics (LAMMPS)

-

Finite-element analysis (ANSYS)

-

Monte Carlo simulation

Dengan performa 95–98% dari bare-metal.

4. Virtualization + Kubernetes

Banyak laboratorium riset modern menjalankan HPC AI melalui:

-

KubeVirt

-

Kata Containers

-

Singularity/Apptainer

yang memungkinkan container berjalan bersama hypervisor untuk isolasi tinggi.

3. Latency & Performance Tuning

Agar virtualisasi dapat dipakai dalam HPC tanpa mengorbankan performa, diperlukan berbagai teknik optimasi.

1. CPU Pinning

Menetapkan vCPU ke physical CPU core tertentu untuk menghindari jitter dan context switching yang berlebihan.

2. HugePages

Menggunakan memory pages besar (2MB/1GB) untuk mengurangi overhead TLB dan meningkatkan throughput aplikasi HPC.

3. Passthrough NIC (SR-IOV)

Memberi VM akses langsung ke NIC berkecepatan tinggi, cocok untuk cluster HPC menggunakan:

-

Infiniband

-

RDMA

-

RoCE

4. NUMA Optimization

Menyesuaikan topology VM dengan physical NUMA node:

-

Memastikan VM tidak melintasi node memory

-

Mengurangi latency akses memori

5. Direct Storage Access

Teknik seperti:

-

NVMe passthrough

-

Virtio-blk/virtio-scsi optimized

digunakan untuk workload analitik besar.

6. Hypervisor Tuning

Melakukan optimasi seperti:

-

Menghapus emulated devices

-

Mengaktifkan paravirtualized drivers (VirtIO)

-

Menggunakan paravirtualized clock for HPC jobs

Dengan tuning ini, performa VM dapat mencapai 95–99% dari bare-metal.

4. Contoh Penerapan Universitas & Laboratorium

Banyak institusi riset global telah menerapkan virtualisasi dalam HPC untuk fleksibilitas dan efisiensi.

1. CERN

CERN menggunakan OpenStack + KVM untuk menjalankan ribuan VM untuk analitik partikel dan simulasi fisika, terutama untuk workload data processing.

2. NASA

NASA memanfaatkan VM dengan GPU passthrough untuk simulasi aeronotika dan pelatihan model deep learning terkait navigasi pesawat.

3. Stanford University

Menjalankan cluster AI berbasis Kubernetes + GPU passthrough untuk riset NLP, visi komputer, dan biologi komputasi.

4. MIT Lincoln Laboratory

Menggunakan HPC virtualization untuk:

-

Analisis radar

-

Simulasi elektromagnetik

-

Pembelajaran mesin tingkat lanjut

5. Universitas Indonesia (UI) dan ITB

Dalam konteks Indonesia, beberapa kampus besar mulai menggunakan virtualized GPU cluster untuk:

-

Data science

-

Pemrosesan citra

-

Penelitian AI

Virtualisasi memberikan fleksibilitas bagi peneliti dalam mengatur lingkungan eksperimen tanpa mengganggu node lain.

5. Perbandingan HPC Bare-Metal vs Virtualized

| Aspek | HPC Bare-Metal | HPC Virtualized |

|---|---|---|

| Performa CPU | Sangat optimal | 95–99% dari bare-metal |

| Performa GPU | Optimal | 90–100% (passthrough) |

| Latency jaringan | Terendah | Lebih tinggi kecuali dengan SR-IOV |

| Isolasi | Rendah | Sangat baik |

| Pengelolaan cluster | Kompleks | Lebih mudah |

| Elastisitas | Rendah | Tinggi |

| Multi-tenant | Sulit | Sangat mendukung |

| Keamanan & sandboxing | Minim | Sangat terisolasi |

| Deployment riset ML | Kurang fleksibel | Sangat fleksibel |

| Sharing resource | Sulit | Mudah (vGPU) |

Kesimpulan Perbandingan

-

Untuk simulasi numerik sangat sensitif latensi → bare-metal lebih unggul.

-

Untuk AI/ML, data science, eksperimen cepat, VDI riset → virtualisasi lebih efisien.

-

Untuk laboratorium multi-user → virtualisasi memberikan fleksibilitas jauh lebih tinggi.